En los últimos meses el escenario internacional parece avanzar hacia una convergencia inquietante entre dos grandes fuerzas que están redefiniendo el poder global: la guerra y la inteligencia artificial. Por un lado, el conflicto en Medio Oriente —con el creciente enfrentamiento entre Estados Unidos, Israel e Irán— vuelve a poner sobre la mesa los riesgos de escaladas militares en una región históricamente inestable. Pero al mismo tiempo, ese conflicto ya no se libra únicamente con misiles, portaaviones o drones. Hoy la guerra también se planifica, se analiza y en algunos casos se ejecuta con sistemas de inteligencia artificial capaces de procesar enormes cantidades de datos en segundos. La pregunta que empieza a surgir es inquietante: ¿hasta qué punto las decisiones de guerra del siglo XXI estarán mediadas por algoritmos?

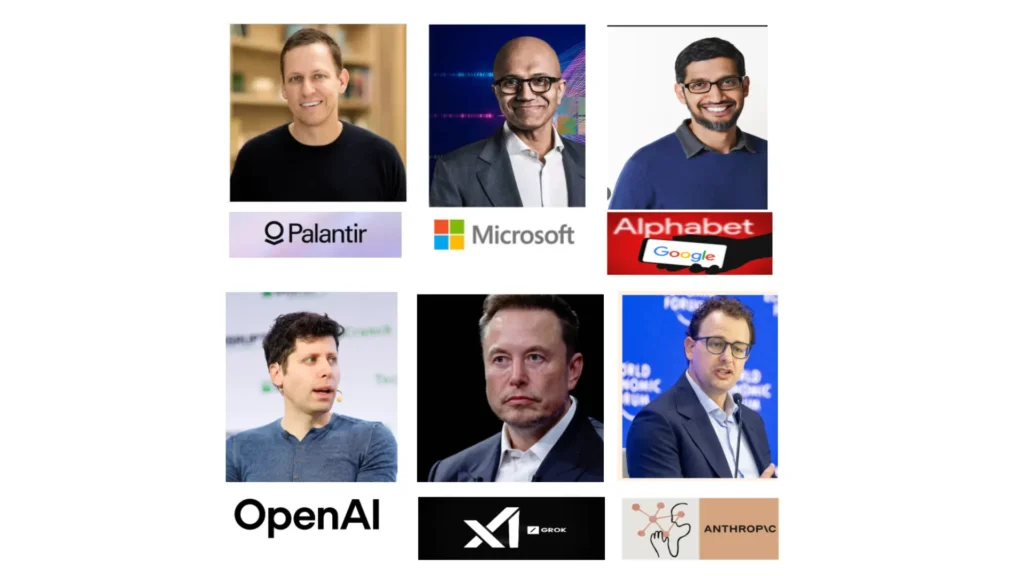

En ese contexto estalló una controversia inédita en Estados Unidos entre el gobierno y una de las empresas más influyentes del mundo de la inteligencia artificial: Anthropic, desarrolladora del modelo Claude. La compañía se negó a permitir que su tecnología fuera utilizada sin restricciones por el Pentágono, especialmente en dos áreas sensibles: vigilancia masiva de ciudadanos y desarrollo de armas autónomas capaces de atacar sin supervisión humana. Esa negativa desencadenó una reacción política muy dura. El Departamento de Defensa llegó a catalogar a la empresa como un “riesgo para la cadena de suministro”, una etiqueta normalmente reservada para adversarios extranjeros, y el gobierno ordenó a las agencias federales dejar de utilizar su tecnología.

Lo que estamos viendo, entonces, es mucho más que un conflicto contractual entre una empresa tecnológica y el Estado. Es el primer gran choque público entre seguridad nacional, ética tecnológica y poder político en la era de la inteligencia artificial. Mientras algunos sostienen que, en un mundo de rivalidades estratégicas con potencias como China o Rusia, Estados Unidos no puede darse el lujo de limitar el uso militar de la IA, otros advierten que abrir esa puerta podría conducir a una carrera armamentística algorítmica sin precedentes.